Kwadrylion obliczeń: jak zasymulowano wydech Super Heavy

Czas czytania: 9 min • 22 listopada 2025 07:37

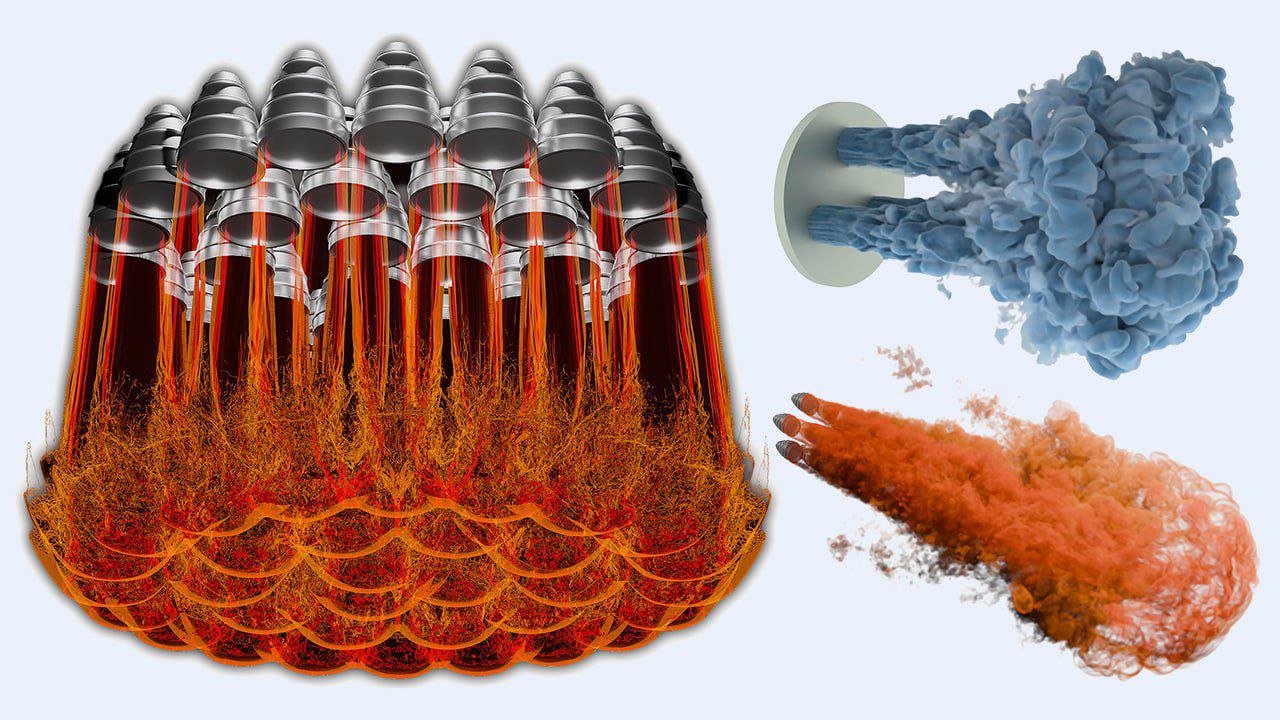

W 2025 roku zespół z Georgia Institute of Technology opublikował na arXiv największą do tej pory symulację przepływów gazowych związaną z rakietą Super Heavy firmy SpaceX. Model obejmował oddziaływania pomiędzy 33 silnikami Raptor, generującymi wielokierunkowe strumienie gazów o ekstremalnych parametrach. Badacze odtworzyli zachowanie przepływów na siatce obejmującej ponad kwadrylion stopni swobody, co stanowi skalę dotychczas niespotykaną w obliczeniach CFD (Computational Fluid Dynamics).

Zespół wykorzystał nowy algorytm numeryczny IGR (Information Geometric Regularization), który eliminuje wiele ograniczeń klasycznych metod stosowanych do modelowania fal uderzeniowych i strumieni hipersonicznych. Symulacja została przeprowadzona na systemie testowym opartym na architekturze superkomputera El Capitan, przygotowywanym przez Lawrence Livermore National Laboratory. Nie był to finalny system El Capitan, lecz węzły przedprodukcyjne przeznaczone do testów wydajnościowych.

Według DOE, nowoczesne systemy HPC są kluczem do badań, których nie da się przeprowadzić eksperymentalnie:

„Najbardziej zaawansowane symulacje pozwalają modelować zjawiska, których nie sposób obserwować bezpośrednio.” — U.S. Department of Energy, informacje o HPC

Dla rakiety Super Heavy takie podejście jest kluczowe. Interakcje strumieni 33 silników stanowią jeden z najtrudniejszych problemów współczesnej aerodynamiki — zarówno ze względu na ekstremalne temperatury, jak i gwałtowne zmiany ciśnienia prowadzące do powstawania złożonych układów fal uderzeniowych.

Dylematy

-

Ekstremalna turbulencja i interferencje strumieni

W pojazdach z wieloma silnikami silnie oddziałujące na siebie strumienie spalin mogą prowadzić do powstawania fal uderzeniowych odbijających się od elementów konstrukcyjnych. NASA w swoich raportach zwraca uwagę, że zjawiska tego typu stanowią jedno z krytycznych ryzyk podczas startów dużych rakiet. NASA Technical Reports Server -

Ograniczenia klasycznych metod numerycznych

W publikacji Georgia Tech autorzy wskazują, że tradycyjne metody „shock-capturing” stają się nieefektywne przy przepływach hipersonicznych — wymagają niezwykle gęstych siatek, co przekłada się na ogromne zapotrzebowanie na pamięć i moc obliczeniową. Dla problemu obejmującego kwadrylion stopni swobody byłoby to praktycznie niemożliwe. -

Potrzeba nowych architektur HPC

DOE oraz LLNL podkreślają, że rosnąca złożoność zjawisk fizycznych wymaga komputerów posiadających zunifikowaną architekturę pamięci CPU–GPU oraz wysoką przepustowość komunikacyjną. Rozwiązania tego typu — stosowane m.in. w El Capitan — stają się konieczne przy symulacjach wieloskalowych.

Symulacja Georgia Tech była przełomowa nie ze względu na samą skalę, ale na sposób jej przeprowadzenia. Klasyczne podejście do modelowania fal uderzeniowych wymaga szczegółowego śledzenia gwałtownych zmian parametrów przepływu. Przy tak ogromnej liczbie silników i ich wzajemnych oddziaływań oznaczałoby to zapotrzebowanie na pamięć i moc obliczeniową przekraczające możliwości współczesnych superkomputerów.

Algorytm IGR i jego znaczenie

Metoda IGR, opracowana przez zespół Georgia Tech, interpretuje fale uderzeniowe jako zmiany geometryczne w przestrzeni informacji, a nie jako ostre nieciągłości wymagające specjalnych technik numerycznych. Dzięki temu możliwe było:

- 80-krotne przyspieszenie obliczeń (liczba orientacyjna)

- 25-krotne zmniejszenie zapotrzebowania na pamięć (liczba orientacyjna)

To właśnie ta innowacja umożliwiła przeprowadzenie symulacji o skali kwadryliona stopni swobody.

Wykorzystanie systemu testowego El Capitan

W publikacji podkreślono, że obliczenia wykonano na węzłach testowych architektury El Capitan, a nie na pełnym superkomputerze. Wstępne węzły pozwoliły jednak na sprawdzenie skalowalności nowego algorytmu i jego efektywności na architekturze heterogenicznej. Zastosowano zunifikowaną pamięć CPU–GPU, co umożliwiło równoległe przetwarzanie ogromnych porcji danych bez konieczności przenoszenia ich pomiędzy różnymi przestrzeniami pamięci. LLNL — El Capitan

Znaczenie wyników

Symulacja pozwoliła szczegółowo zobrazować:

- interferencje strumieni spalin przy wielosilnikowej konfiguracji rakiety,

- powstawanie i propagację fal uderzeniowych,

- struktury turbulencyjne typowe dla przepływów hipersonicznych,

- potencjalne obciążenia aerodynamiczne oddziałujące na podstawę rakiety.

Nie są to dane operacyjne SpaceX — badacze przeprowadzili symulację naukową opartą na modelach fizycznych i dostępnych parametrach. Wyniki mogą znaleźć zastosowanie w przemyśle kosmicznym, energetyce, aerodynamice i wielu pozostałych dziedzinach nauki.

Szersze zagrożenia i konsekwencje

-

Ryzyko termiczne i mechaniczne

Złożone pola fal uderzeniowych mogą prowadzić do lokalnych przeciążeń. NASA opisuje takie zjawiska jako jeden z głównych czynników ryzyka konstrukcyjnego. -

Wysokie zapotrzebowanie na moc obliczeniową

Symulacje tej skali mogą być wykonywane wyłącznie na systemach klasy exascale lub przedprodukcyjnych platformach je odwzorowujących, co tworzy nierówności sprzętowe pomiędzy ośrodkami naukowymi. -

Zastosowania w wielu dziedzinach

Choć praca dotyczyła rakiet, modele przepływów hipersonicznych mają znaczenie także w aerodynamice, energetyce, projektowaniu silników i badaniach bezpieczeństwa.

Rekomendacje lub dobre praktyki

- Dalszy rozwój metod redukujących koszt obliczeń, takich jak IGR, aby umożliwić prowadzenie symulacji wielkoskalowych także mniejszym ośrodkom.

- Tworzenie otwartych benchmarków CFD, pozwalających na porównywanie wydajności algorytmów w warunkach ekstremalnych przepływów.

- Łączenie danych eksperymentalnych z modelami numerycznymi — rekomendowane przez NASA i MIT — aby wykrywać ewentualne błędy interpretacyjne. Praca Georgia Tech jest jednym z największych osiągnięć współczesnej numerycznej aerodynamiki. Dzięki algorytmowi IGR i wykorzystaniu węzłów testowych systemu o architekturze El Capitan badaczom udało się odwzorować zjawiska, których nie sposób zaobserwować eksperymentalnie.

Symulacja nie korzystała z finalnego systemu El Capitan ani z niejawnych danych SpaceX — była to praca naukowa, mająca na celu rozwój metod do modelowania przepływów hipersonicznych.

Autorzy zgłosili pracę do konkursu Gordon Bell Award, jednak oficjalna lista nominacji nie została jeszcze opublikowana.

📚 Źródła

- Georgia Tech — Information Geometric Regularization for Large-Scale Hypersonic Flows

- U.S. Department of Energy — informacje o infrastrukturze HPC

- NASA Technical Reports Server

- Lawrence Livermore National Laboratory — system El Capitan

- Nature Computational Science — editorial o symulacjach wielkoskalowych

Brak innych postów do wyświetlenia